La inteligencia artificial no conoce fronteras, pero sus riesgos y beneficios sí. Es momento de un pacto global basado en principios universales, no leyes fragmentadas. #DerechoIA #FuturoDigital #ÉticaTecnológica

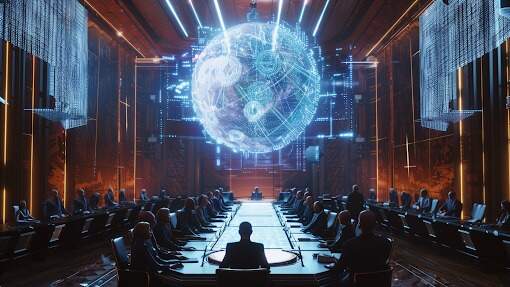

El avance imparable de la inteligencia artificial (IA) ha dejado a gobiernos, empresas y ciudadanos enfrentándose a una encrucijada de proporciones históricas. No se trata solo de la velocidad con la que esta tecnología está transformando nuestras vidas, sino del poder que concentra en manos de quienes la controlan. Aquí no estamos hablando de ajustar una tuerca local, sino de un esfuerzo coordinado globalmente para definir los principios que guiarán este fenómeno.

La regulación de la inteligencia artificial no puede limitarse a fronteras geográficas. Internet y la tecnología ya han probado que las leyes nacionales a menudo son insuficientes para contener fenómenos globales. Por eso, el llamado no es hacia una legislación fragmentada que varíe según el país, sino hacia un marco internacional basado en el derecho, ese lenguaje universal de principios que trasciende culturas y políticas.

El derecho no es lo mismo que la ley. Mientras que la ley es la herramienta concreta con la que se intenta resolver problemas específicos dentro de un contexto nacional, el derecho es más amplio. Se fundamenta en principios éticos y universales que buscan el equilibrio y la justicia en un mundo compartido.

En el caso de la IA, urge establecer un derecho internacional que considere la humanidad como un todo. Conceptos como la soberanía tecnológica, el derecho a la privacidad digital, la autonomía de los individuos frente a sistemas automatizados, y la protección de los datos personales no deben ser tratados como simples normativas nacionales. Necesitan elevarse al nivel de derechos fundamentales, protegidos por acuerdos globales.

Además, está la necesidad de definir responsabilidades claras. ¿Quién responde cuando un sistema de IA discrimina o perpetúa sesgos? ¿Qué ocurre cuando un algoritmo decide sobre la libertad o la vida de una persona? Sin un marco internacional, estas preguntas quedan sin respuesta y los riesgos de abuso aumentan exponencialmente.

Imaginemos un mundo donde cada país decida por su cuenta cómo implementar y controlar la IA. Mientras unos podrían optar por la total libertad para la innovación, otros podrían imponer controles extremos o incluso prohibiciones. Esta falta de coordinación no solo generaría desigualdades, sino también una posible “carrera armamentista” en la que las potencias tecnológicas compiten sin límites éticos, poniendo en peligro a las sociedades menos preparadas.

Es aquí donde entra en juego el derecho internacional como mediador. Los principios de transparencia, explicabilidad y responsabilidad deben formar parte de un pacto global. Por ejemplo, los desarrolladores de IA deberían estar obligados a explicar cómo funcionan sus algoritmos, especialmente cuando estos impacten decisiones críticas como contrataciones, diagnósticos médicos o sistemas judiciales.

A su vez, debe garantizarse que estas tecnologías respeten la dignidad humana. No podemos permitir que los sistemas de vigilancia masiva, habilitados por la IA, se conviertan en herramientas de opresión. El derecho internacional debe fijar límites claros sobre el uso de estas tecnologías, priorizando siempre la libertad y la privacidad.

La Declaración Universal de los Derechos Humanos, adoptada en 1948, marcó un hito en la historia de la humanidad al establecer un conjunto básico de derechos fundamentales. Sin embargo, en el siglo XXI, esos derechos necesitan una reinterpretación en el contexto de la revolución digital.

La IA plantea nuevos desafíos para los derechos humanos:

- Privacidad y datos personales: En un mundo donde todo se mide y almacena, garantizar la privacidad se vuelve vital. El derecho debe proteger a las personas de la explotación de sus datos.

- Equidad y no discriminación: Los algoritmos pueden amplificar prejuicios existentes si no se diseñan cuidadosamente. Es imperativo exigir transparencia y auditorías regulares para evitar que la IA perpetúe injusticias.

- Acceso igualitario: La IA tiene el potencial de cerrar o ensanchar brechas sociales. Garantizar que sus beneficios sean accesibles para todos, independientemente de su origen, es una prioridad moral y ética.

- Derecho al trabajo y la dignidad: Con la automatización desplazando empleos, surge la necesidad de replantear cómo las sociedades valoran y protegen la contribución de cada individuo.

La creación de un marco de derecho internacional sobre IA no es una tarea fácil, pero es posible. Tal vez debamos inspirarnos en acuerdos previos como el Protocolo de Kioto o los Objetivos de Desarrollo Sostenible, donde las naciones reconocieron que hay problemas que simplemente no pueden ser resueltos de manera aislada.

Es hora de que científicos, líderes políticos, tecnólogos y ciudadanos unan fuerzas para forjar un pacto global. Este pacto debe basarse en la ética, la sostenibilidad y el respeto por las generaciones futuras.

Regular la inteligencia artificial no es solo una cuestión técnica; es un reflejo de nuestros valores como especie. ¿Qué elegimos priorizar? ¿La ganancia inmediata o un desarrollo que garantice la equidad y la justicia?

Este momento es histórico. Tenemos la oportunidad de demostrar que, aunque nuestra tecnología puede superar las fronteras, nuestros principios son lo que realmente define nuestra humanidad.