España impone reglas a la IA: A partir de agosto, la Aesia podrá multar a empresas que usen IA de forma ilegal. ¿Supervisión necesaria o freno a la innovación? #InteligenciaArtificial #España #Tecnología

Imaginen un mundo donde cada decisión tomada por una inteligencia artificial sea supervisada con lupa, donde las empresas que incumplen las normas no solo reciban advertencias, sino también multas millonarias. Pues bien, España se prepara para dar ese paso con la Agencia Española de Supervisión de Inteligencia Artificial (Aesia), que, a partir de agosto, podrá imponer sanciones a quienes violen la normativa. Pero, ¿estamos ante un avance en la protección de los derechos digitales o frente a una maquinaria burocrática que podría frenar la innovación?

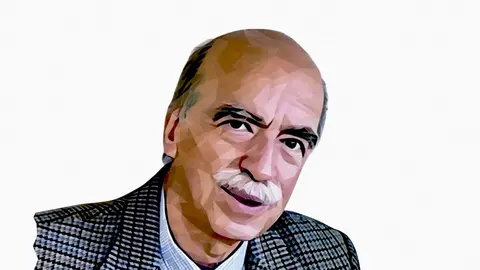

Desde su sede en A Coruña, la Aesia no pretende ser simplemente una entidad recaudadora. Su enfoque, según su director Ignasi Belda, será más bien disuasorio que punitivo. Antes de multar, preferirán advertir a los infractores, asegurándose de que las empresas comprendan y cumplan las regulaciones. Sin embargo, el poder de sanción está ahí, listo para actuar cuando sea necesario.

Pero la pregunta clave es: ¿qué se podrá y qué no se podrá hacer con la IA en España? Según la nueva legislación, ciertas prácticas estarán completamente prohibidas. Entre ellas, el reconocimiento emocional en entornos laborales y educativos, la manipulación subliminal y la predicción de delitos. En otras palabras, la IA no podrá leer nuestras emociones en el trabajo ni anticipar crímenes antes de que ocurran, al más puro estilo de Minority Report.

El rápido avance de la IA ha desatado un debate global sobre sus riesgos y beneficios. Por un lado, esta tecnología promete optimizar procesos, hacer más eficiente la toma de decisiones y mejorar nuestra calidad de vida. Pero, por otro lado, sus riesgos son evidentes: sesgos algorítmicos, pérdida de privacidad, toma de decisiones opacas y la posibilidad de que el poder se concentre en unas pocas manos.

En este contexto, la regulación se convierte en un arma de doble filo. Mientras algunos la ven como un escudo protector contra los abusos tecnológicos, otros temen que termine asfixiando la innovación. La Aesia busca un equilibrio, pero su margen de maniobra será clave para determinar si logra su objetivo o si, por el contrario, se convierte en un freno para el desarrollo de la IA en España.

Además, la agencia nace con un equipo reducido: actualmente cuenta con solo veinte empleados, aunque esperan llegar a sesenta este año y, eventualmente, a ochenta. Un número aún modesto para supervisar ocho ámbitos distintos de la IA y garantizar que no se produzcan abusos. Con un mercado en expansión y una regulación europea cada vez más estricta, la capacidad operativa de la Aesia será puesta a prueba desde el primer día.

Uno de los puntos que más enfatiza Belda es la necesidad de que la inteligencia artificial sea transparente y explicable. Es decir, que no se convierta en una “caja negra” donde los ciudadanos y las empresas no entiendan cómo se toman las decisiones. Este es un problema crítico en la IA actual, donde algoritmos complejos pueden tomar decisiones con consecuencias graves sin que nadie sepa exactamente cómo lo hicieron.

Imaginemos, por ejemplo, un sistema de selección de personal basado en IA que, sin explicación aparente, rechaza sistemáticamente a candidatos de ciertos perfiles. O un software que determina el riesgo crediticio de una persona sin revelar los criterios exactos que utiliza. Si estos sistemas no son transparentes, se abre la puerta a discriminaciones invisibles, contra las cuales es prácticamente imposible luchar.

Por eso, la Aesia deberá garantizar que las decisiones algorítmicas sean comprensibles, justificadas y auditables. Esto no solo protegería a los ciudadanos, sino que también ayudaría a generar confianza en el uso de la IA en sectores clave como la salud, la educación y la justicia.

España ha dado pasos importantes en la supervisión de la inteligencia artificial, pero aún queda camino por recorrer. Mientras que la Unión Europea avanza con su Ley de Inteligencia Artificial, que busca establecer un marco común para toda Europa, la Aesia podría posicionar a España como un país pionero en la materia. Sin embargo, la efectividad de la agencia dependerá de su independencia, su capacidad para hacer cumplir las normas y su habilidad para adaptarse a una tecnología que cambia a una velocidad vertiginosa.

En este escenario, no solo las grandes empresas tecnológicas deberán prestar atención a la Aesia, sino también startups, administraciones públicas y cualquier entidad que utilice IA en sus procesos. La supervisión será más estricta y las sanciones podrían marcar un antes y un después en el desarrollo de esta tecnología en España.

El reto ahora es encontrar el equilibrio entre proteger los derechos de los ciudadanos sin frenar la innovación. Porque si bien es cierto que necesitamos reglas claras, también lo es que un exceso de burocracia podría dejar a España atrás en la carrera global de la inteligencia artificial.

La cuenta atrás ha comenzado. A partir de agosto, la IA en España tendrá un nuevo guardián. ¿Será un aliado del progreso o un obstáculo para la innovación? El tiempo, y las primeras sanciones, nos darán la respuesta.